人工智能与司法裁判深度融合的路径分析

——基于法学方法论视角

王志勇

(河南财经政法大学 法学院,河南 郑州 450046)

辛淑静

(河南金学苑律师事务所,河南 郑州 450046)

内容摘要:在当下中国司法裁判的实践领域,人工智能的适用呈现外“热”内“冷”的境况。理论界多关注于人工智能与司法裁判融合的可能与限度,鲜有从具体融合路径展开的谱系性分析,未能提供实现两者深度融合的方法论指导。从人工智能的核心方法论与司法裁判的整体构造来看,两者深度融合的路径有内外之分。内在路径关注人工智能如何进入司法裁判的发现与证立层面,前者涉及人工智能为进行精确预测可能涉及的心理、社会等因素,后者涉及法律论证的逻辑建模。外在路径关注从更为宏观的角度达致人工智能与司法裁判深度融合的诉讼程序与司法制度,前者涉及完成诉讼辅助性事项、实现司法流程标准化管理等内容,后者涉及法官的角色定位、司法责任、司法行政管理等制度性问题。为实现审判体系与审判能力现代化,中国司法改革未来需要内外路径兼修、一体化推进两者的深度融合。

关键词:人工智能;司法裁判;深度融合;路径分析

中图分类号:D920.0

文献标识码:A

文章编号:2095-3275(2022)03-0023-10

一、导言

得益于计算能力的提升和大数据技术的进步,人工智能迅速发展,对国家战略安排及社会主体的行为方式产生了深刻影响。人工智能的发展也给法官的裁判活动带来了机遇和挑战。2019年2月,最高人民法院发布的《

人民法院第五个五年改革纲要(2019—2023)》明确提出,“充分运用大数据、云计算、人工智能等现代科技手段”“推动实现审判方式、诉讼制度与互联网技术深度融合,构建中国特色社会主义现代化智慧法院应用体系”。然而,目前来看,“中国司法系统斥巨资力推的大数据及人工智能技术在司法实践中的运用效果并不理想”

[1]。可是,如何真正推进司法裁判与人工智能技术的深度融合呢?这就需要我们从更深层次思考两者融合的法理基础,并在此基础上探索实现两者融合的路径。

法律推理领域的人工智能研究始于布坎南和亨德里克于1970年发表的《关于人工智能和法律推理若干问题的考察》,该论文提出了理解、模拟法律推理所需要的各类知识以及如何将之应用于编制计算机程序

[2]。之后的研究大致随着人工智能技术的发展而不断拓展

[3],当前人工智能与法律的相关研究的目标大多在于设计计算机模型从而能够提出法律论证并预测法律争议的结果,并且开发了诸如Ross,lex Machina,Ravel等新的法律应用程序

[4]。然而,这些研究多从律师角度试图设计诸如微信、支付宝一类的应用软件系统,而且人工智能在司法裁判中的应用也引发了一定的争议。尽管注意到人工智能在司法裁判领域适用的可能风险

[5],但国内学术界对于人工智能在司法裁判领域的应用总体上保持高度的热情,这可以由最近几年相关论文发表数量佐证。然而,相关研究多从宏观层面论述人工智能在司法裁判中的价值、限度,鲜有从人工智能、司法裁判的内部机理入手探讨两者深度融合的实践路径问题。基于上述状况,深入到人工智能、司法裁判内部探讨两者融合的路径问题很有必要。为保持研究对象的确定性,笔者的探讨主要基于中国的司法语境,将人工智能与司法裁判深入融合的路径进行了类型化,并且详细分析诸种路径的内容和其中可能蕴含的难题,以期为进一步的相关研究提供理论基础,并为未来司法裁判中人工智能的应用提供有益参考。

二、人工智能与司法裁判深度融合的法理基础

从1946年第一台计算机诞生以来,人们一直寄希望于计算机能具有更强大的功能。21世纪以来,得益于计算能力和大数据发展,加之近年来媒体对AlphaGo陆续击败人类围棋高手的渲染,人工智能迅速引发全球热潮

[6]。可以说,人工智能裹挟着巨大变革力正在深刻且全面地影响着庞大国家的战略走向和卑微个体的命运选择。作为审判活动的司法裁判并非自我运转的封闭系统,法官在司法裁判中所使用的方法毫无例外地也主动或者被动地“遭遇”了人工智能。如此,我们不禁会追问:当司法裁判方法“遭遇”人工智能时,两者之间会碰撞出什么样的火花呢?

(一)人工智能的源流与核心方法论

顾名思义,人工智能就是智能的人工化,或者人类智能思考的机械化。其观念史源远流长,早期萌芽或许可以追溯到亚里士多德,他最早提出一种类似回归规划系统的算法

[7]。17世纪的一些思想家尝试将理性思考化约为数学体系。例如,霍布斯在《利维坦》引言中就谈道由于生命只是肢体的一种运动,它的起源在于内部的某些主要部分,那么我们为什么不能说,一切像钟表一样用法条和齿轮运行的‘自动机械结构’也具有人造的生命呢?

[8]而且他明确提出“推理就是一种计算”

[9]。莱布尼茨也曾设想:“我们要造成这样一个结果,使所有推理的错误都只成为计算的错误,这样,当争论发生的时候,两个哲学家同两个计算家一样,用不着辩论,只要把笔拿在手里,并且在算盘面前坐下,两个人面对面地说:让我们来计算一下吧。”

[10]1950年,图灵发表了《计算机与智能》一文,这通常被认为是人工智能学科的源头

[11]。严格来讲,现代人工智能起源于1956年的达特茅斯会议,自此之后人工智能成为一门独立的学科。达特茅斯会议发起建议书中曾将其预期目标设想为,学习或者智能的其他方面都可以被精确地描述,从而我们能够制造一台机器模拟之。

[12]。所以,有些当代学者就提出,人工智能宣称的目标是创建可以与人类的思维媲美的计算机软件或者硬件系统,即表现出与人类智能相关的特征

[13]。如果说人类智能的表现形式是知识,那么也可以说人工智能的研究是以知识的表示、获取和应用为归依。从逻辑学上讲,知识的基本单位是概念,而且知识本身也是一个概念。由此人工智能的问题就转变为如何表示、学习和应用概念。按照经典概念定义,逻辑学上通常区分概念的名称、内涵与外延,由此,概念具有指名、指心与指物功能。围绕如何让机器具有智能,人工智能的发展呈现为专注于实现人工智能指名功能的符号主义、专注于实现人工智能指心功能的连接主义与专注于实现人工智能指物功能的行为主义。具体而言,符号主义主张,只要在符号计算上实现了相应的功能,那么在现实世界就实现了对应功能。连接主义关注概念的心智表示以及如何在计算机上实现其心智表示。行为主义假设智能取决于感知与行动,只要把智能行为表现出来就具有智能。目前各个流派进行融合已经是大势所趋,特别是在大数据和云计算的助力下,新一代人工智能将引发新的技术革命

[14]。时至今日还没有一个被大家一致认同的精确的人工智能定义,因为“人工”固然可以被界定为“非自然、人造的”,但“智能”的界定却是一个涉及多学科的难题。也正是基于此,人工智能的发展历史就呈现为一种“百舸争流”的局面。

尽管尚未就人工智能的定义达成共识,但我们也许可以比较形象地讲,人工智能这门科学,就是让机器做智能人类才能完成的事情。如果我们不纠结于概念的诸功能而从智能人类整体角度来看,那么正如诺维格等人所讲,理性行动者(rational agent)就可能作为人工智能方法的核心。而所谓“理性行动者”,指一个为了实现最佳结果,或者当存在不确定性时,为了实现最佳期望结果而行动的行动者

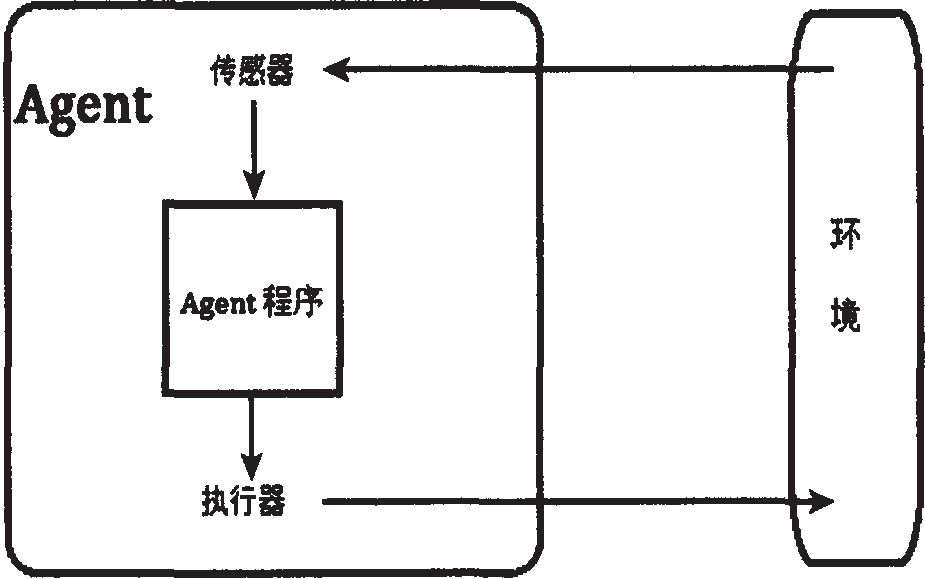

[1]。根据判断理性的根据,诺维格等人给出理性行动者的定义,即对每一个可能的感知序列,根据已知的感知序列提供的证据和行动者具有的先验知识,理性行动者应该选择能使其性能度量最大化的行动。作为人工智能核心方法论的理性行动者包括性能、环境、执行器和传感器。就此,可以具体图示如下

[15]。

在此,我们可以自动驾驶汽车系统为例来说明。通常,自动驾驶的性能度量包括安全、快速、能耗低等,自动驾驶的环境包括各种各样的道路状况,自动驾驶车的执行器包括油门、刹车灯,传感器则至少包括视频摄像头、速度表等。然而,这其中最为核心的地方在于行动者程序,其能够实现把感知信息映射到行动的行动者函数。从这个角度来看,人工智能的任务其实就是设计行动者程序。理论上通常存在4种基本的行动者程序,即基于简单反射的行动者、基于模型的行动者、基于目标的行动者、基于效用的行动者

[16]。归根结底,每种行动者程序的任务其实就是以特定的方式结合特定的成分来生成行动。例如我们可以计算机语言设计条件-行为规则来实现“如果前方路口红灯亮,那么就要刹车”的自动驾驶模式。除了自动驾驶之外,常见的人工智能系统还有扫地机器人、语音识别系统以及机器翻译等。当然,每种行动者程序在具体的领域的任务各不相同,而人工智能则希望发现不受领域限制、适用于所有领域的知识表示、获取、应用的一般规律、算法等。由此我们就可以理解当下人工智能的知识体系构成:知识表示包括有知识图谱,知识获取则包括各种搜索技术、人工神经网络、深度学习等,知识应用则包括专家系统、规划、自然语言处理、语音识别甚至智能机器人等

[17]。无论如何,这些具体的知识板块其实都是为了理解和建造各式各样的理性行动者。

(二)司法裁判的目标与整体构造

当下国内法学界通常将“司法”界定为,人民法院和人民检察院行使审判权和检察权的活动

[18],但本文所探讨的“司法”仅仅指法院或者法官行使审判权的活动。此种意义上的司法活动指特定国家的法官按照一定的诉讼程序审理个案纠纷时将该国家现行有效的法律规范适用于具体案件事实获得一个正当法律决定的过程或活动

[19]。人工智能作为一种技术融入司法裁判,必然涉及两个前提方面的问题。其一,要不要融入?这涉及对人工智能在实现司法裁判的目标方面的作用的判断。其二,如何融入?这涉及对作为整体概念司法裁判进行结构分析,以考察人工智能可能的融入路径。下文将分别从目标和整体构造角度对司法裁判展开探讨。

司法裁判的首要任务在于解决纠纷,因为诉讼案件实际上就是纠纷本身。然而,纠纷解决的功能并非独为司法审判所具有,协商、调解甚至暴力活动也具有纠纷解决的社会功能。或者说,裁判仅仅是社会归序的一种形式而已,由此人们之间的关系得以被调整

[20]。显然,在纠纷解决之外必然还有其他内容将司法裁判与其他纠纷解决方式区分开来。就此,日本学者棚濑孝雄曾以两条相互独立的基轴将纠纷解决过程进行类型化,其一是纠纷是由当事人之间自由的“合意”还是由第三方有拘束力的“决定”来解决,由此形成合意性-决定性之轴;其二纠纷解决的内容是否事先为规范所规制,由此形成恣意的决定过程-法的决定过程。尽管不同类型之间的区分是相对的,但其所描述的类型轴中,司法审判大体上偏重于规范性与决定性

[21]。依照其类型化观点,与其他类型的纠纷解决过程相比,审判的独特之处在于其解决纠纷的方式具有决定性和规范性。由此可见,司法裁判的目标除了纠纷解决之外,更在于以特定的方式解决纠纷。在美国学者富勒看来,作为社会归序形式的裁判的独特性在于,其赋予当事人以特定形式从而使其能够参与裁判结果的形成过程,这些特定形式包括提出对其有利的证据和理性之论据

[22]。所以,“说理”就构成了司法裁判最为核心的本质,其中的“理”既包括规范理性理由也包括事实性理由。对于现代法治社会而言,最终规范性理由无疑是法律规范,所以司法裁判首先要“依法”论证。此外,司法裁判还要实现“个案正义”,因为“(法学)所关心的不仅是明确性及法的安定性,同时也致意于:在具体的细节上,以逐步的工作来实现‘更多的正义’”

[2]。从此意义上讲,司法裁判的最终目标是获取并且证立一个正确的或者理性的判决(a correct or rational decison)

[23],其内含着“依法裁判”与“个案正义”两个具体要求。

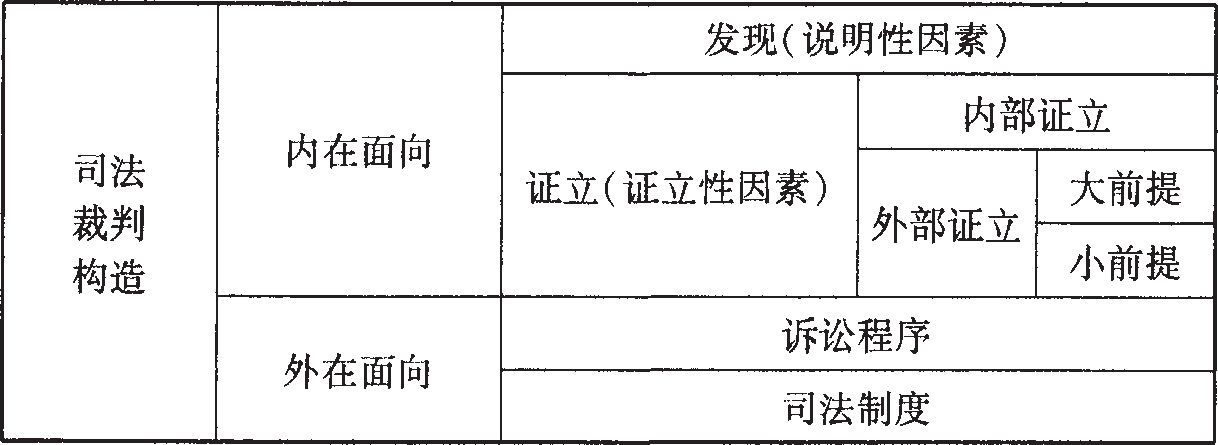

如果司法裁判的目标在于获取并证立一个理性的判决,那么司法裁判至少包含“发现”与“证立”两个层面的活动。“发现”与“证立”两分源自科学哲学中心理与逻辑的两分

[24],也即某个科学思想的具体发现过程与证明该思想的过程两分。美国法学家瓦瑟斯特罗姆最早在法学领域区分了“发现的过程”与“证明的过程”

[25]。在裁判语境下,前者指法官作出裁判时的真实过程,涉及直觉、心理等因素;后者指法官对裁判结果进行论证说理的理性重构过程,涉及逻辑、证明等因素。此种区分在法学中最大的意义在于回应法律现实主义对司法裁判客观性的解构

[26],对于本文而言此种区分有助于我们更为全面地观察司法裁判的多重维度。在此基础上,法律论证理论者通常又将证立区分为内部证立和外部证立,前者涉及结论是否从为了证立而引述的前提中逻辑推导出来,后者涉及前提本身的正确性问题。以上的考察集中于司法裁判的过程本身,然而任何司法裁判其实都处于一定的外部环境之中,外部因素往往也会影响到司法裁判本身,例如特定国家的司法制度、政治制度甚至文化传统等因素

[27]。一旦从功能性描述视角来考察,那么更为宽泛的内容将会进入我们的视野

[28]。这其中,最为直接相关的当属程序规则,其次相关的是司法制度。如果我们排除文化传统等过于“偏远”的因素,那么司法裁判其实还涉及了制度和程序面向。由上分析可见,一个关于司法裁判的完整构造不仅仅包括“发现”和“证立”本身,而且也包括“诉讼程序”和“司法制度”这些相对外围的面向。由此,我们可以将司法裁判的整体构造图示如下:

(三)当司法裁判遭遇人工智能:内在路径与外在路径

(三)当司法裁判遭遇人工智能:内在路径与外在路径

由上考察可见,人工智能的核心方法论是理解和创造理性行动者,而司法裁判也具有多重构造维度。对照分析,就获取裁判结论的发现活动而言,人工智能研究可以理解并且设计特定的行动者程序进行计算建模,从而辅助、预测法官的司法裁判;就论证裁判结论的证立活动而言,当前的法律论证理论本身已然发展出诸多论证模型,完全有希望在此基础上实现一定程度的论证推理的模型化,增强司法裁判的释法说理性。当然,“发现”“证立”都是在一定的诉讼程序、司法制度的外部结构之中进行的法律适用,外部结构对法律推理无疑具有制度性约束,例如抗辩式和纠问式的诉讼程序必然影响小前提的获取,对法官地位的不同理解也必然影响到法律解释的诸种方法之选择。所以,人工智能融入司法裁判至少具有上述四种可能性途径。鉴于发现和证立属于司法者进行裁判活动的内在本身层面,所以本文称之为“内在路径”;诉讼程序和司法制度更多属于外在于裁判活动本身的宏观层面,所以本文称之为“外在路径”。然而,这些路径是否可行,各个路径又涉及哪些内容,我们仍需详细考察。

三、人工智能与司法裁判深度融合的内、外路径

人工智能在法的发现和法的证立层面的应用涉及计算机、法学甚至认知神经学等诸多学科,所以此方面的研究必然是交叉学科的研究。另一方面,对人工智能融入司法裁判的诉讼程序、司法制度的研究更多涉及特定国家的诉讼程序和司法制度,具有一定的经验性。所以,对内外路径的展开分析,既要从多学科的角度进行剖析,又要注意特定国家的制度环境的“地方性”。

(一)发现的路径

就获致一个正确的裁判结论的发现路径而言,人工智能如何融入其中呢?我们认为,人工智能的工作当前主要体现在精确预测,从而为法官的裁判行为提供指导。理由在于关于人工智能的两种假设,即弱人工智能与强人工智能。通常,前者指“机器能够智能地行动(其行动看起来如同它们是有智能的)”,后者指“能够如此行事的机器确实是在思考(不只是模拟思考)”

[29]。强人工智能是否能够实现,本身在理论上就值得怀疑,其中最著名的反驳来自约翰·塞尔的“中文屋”

[30]。即使理论上具有实现可能,至少就目前来看,强人工智能仍旧只是科幻电影《机器姬》里面的幻象。鉴于弱人工智能本身是在模拟人类思考而非代替人类思考,所以目前人工智能在司法中应用的主要研究方向在于模拟人类法官思考,发展出相应的人工智能预测模型。例如,在2016年,伦敦大学学院、谢菲尔德大学和宾夕法尼亚大学的科学家研制的人工智能程序,对欧洲人权法院584个案件进行数据分析并提出裁决,其结果与人类法官的裁决达到了79%的相似率

[31]。从裁判理论来看,此种路径下的人工智能更多属于偏重于法律现实主义的非正统立场,这与坚持理性证立的诸如法律形式主义立场形成了对比。也即,人工智能在发现路径中的模拟秉持一种“现实主义”立场。为了准确预测裁判结果,理性行动者要能够理解人类法官裁判的“真实”过程,辨识影响裁判结果的“环境”因素,在此基础上编制相应的算法进行科学预测。然而,正如法律现实主义所见,人类决定的作出往往受到很多因素的影响,其中包括制度、利益、经验、情感甚至偏见等。如果单纯就预测而言,基于目标的行动者的设计可以将精确的“外部观察者”预测作为其性能度量,并由此分析相关影响裁判作出的因素。然而,这里仍旧面临一些难题:如何获知法官裁判的“真实”因素?这些因素如何导致最终结论的产生?这构成了人工智能设计中的“知识获取(knowledge acquisition)”难题。